國際 | 全球話題

Sam Altman:AI恐招致滅絕!這份22字公開信,AI教父Geoffrey Hinton也簽名

1.5月30日,一封只有22個字的公開信引起軒然大波。簽名者中,包含Geoffrey Hinton和Yoshua Bengio兩位人工智慧「教父」,還有矽谷巨頭的重要人物。

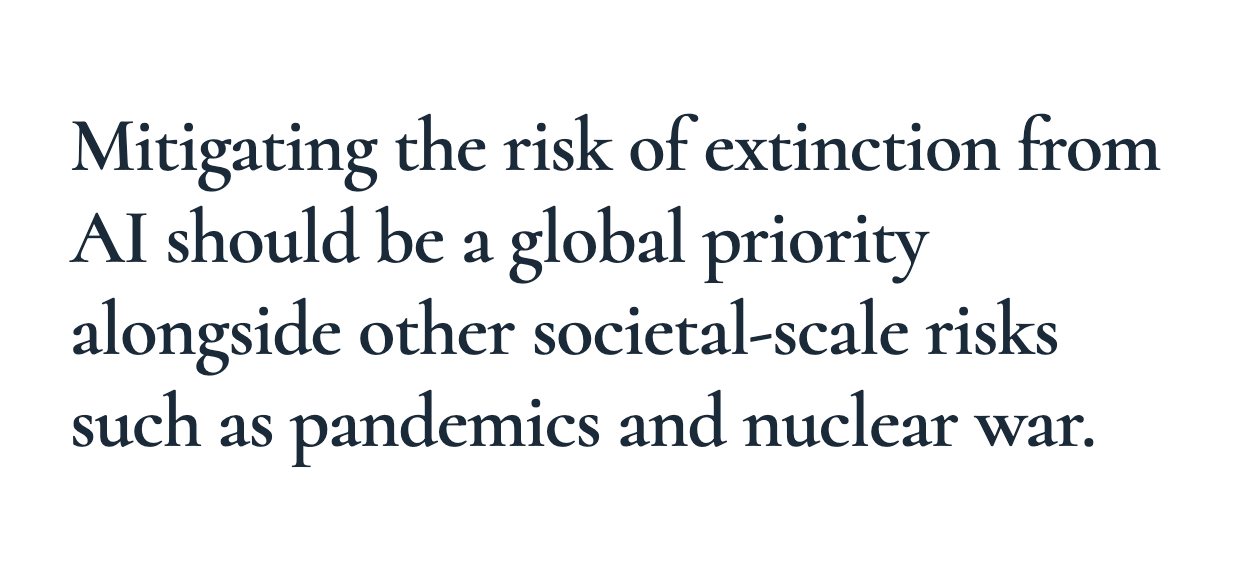

2.這封公開信,呼籲我們應該重視AI帶來滅絕性的風險,並把對這件事的優先序,提高到全球級別,就像我們應對傳染病、核戰這種全球性危機一樣。

3.AI足以滅絕人類的風險包括:武器化、資訊誤傳、AI成人類代理人並利用人類、人類將退化、AI技術被壟斷、發展不可控、AI欺騙人類、各國競逐權力。

3月,千名大老簽署暫停「超級AI」研發的公開信,讓整個業界為之震驚。就在5月30日,一封只有22個字的公開信再次引起軒然大波。

幾句話,把AI類比為傳染病和核戰、分分鐘能滅絕人類的那種東西。

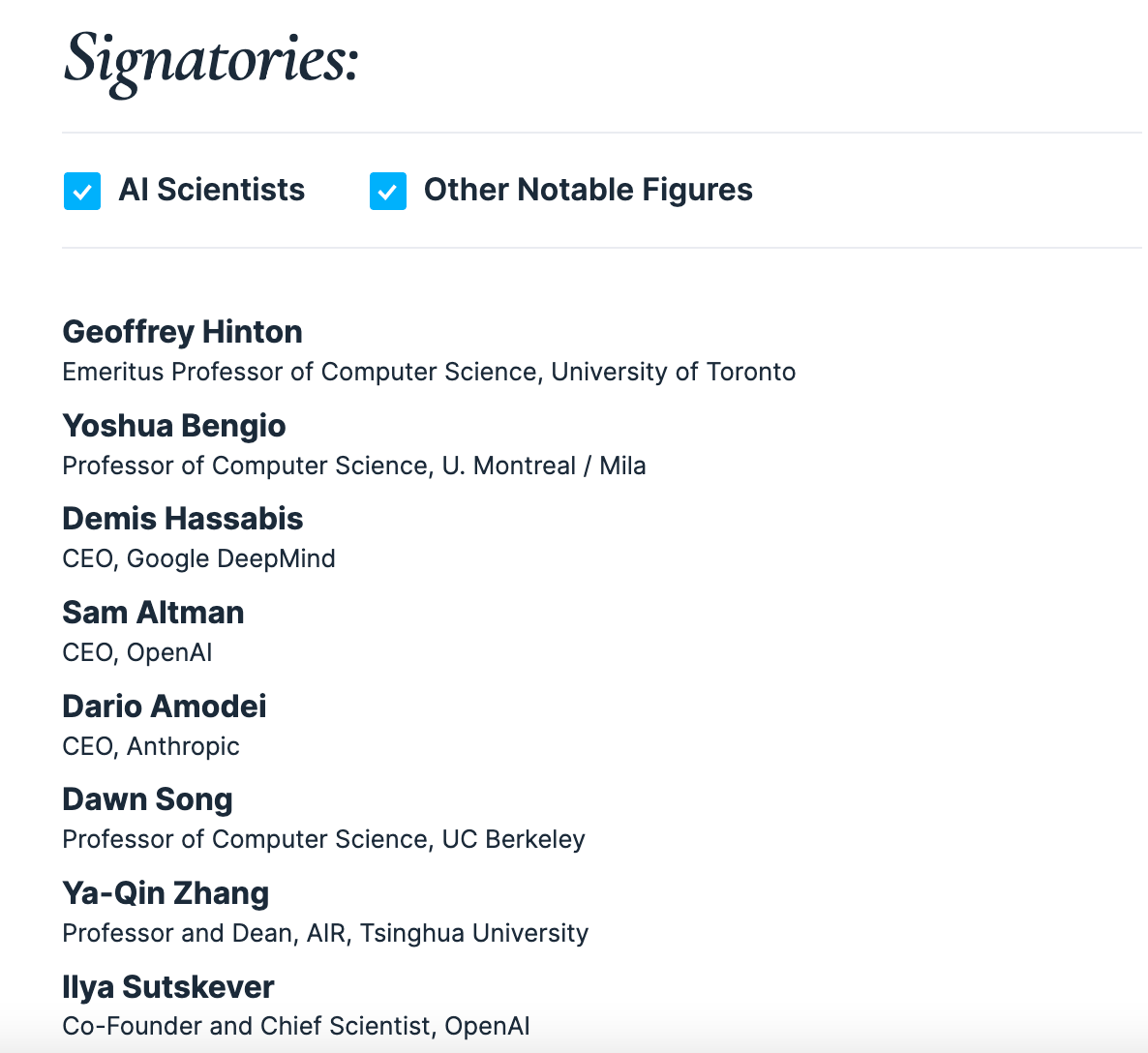

簽名者中,有Geoffrey Hinton和Yoshua Bengio兩位人工智慧「教父」,還有矽谷巨頭的重要人物,像是Sam Altman(OpenAI執行長)、Demis Hassabis(DeepMind創辦人)在人工智慧領域工作的研究人員。

截至目前,已經有370多名從事人工智慧工作的重要人物都簽署了這份公開信。然而,這封信並不是得到所有人的支持。

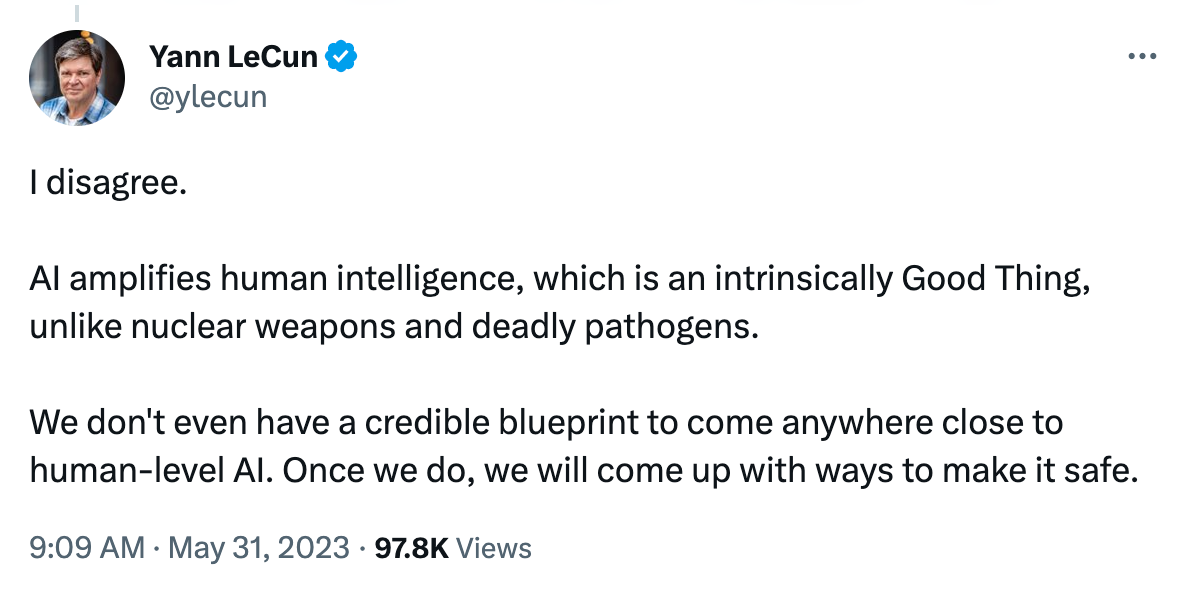

「圖靈3巨頭」中的一位Yann LeCun直言:我不同意。(編按:2019年電腦界的最高榮譽獎項圖靈獎,頒發給3位在深度學習領域做出重大貢獻的巨頭:Yoshua Bengio、Yann LeCun和Geoffrey Hinton。)

「人工智慧放大了人類的智慧,這在本質上是一件好事,與核武和致命的病原體不同。我們甚至沒有一個可靠的藍圖來創造接近人類水準的人工智慧。一旦我們做到了,我們會想出讓它安全的方法。」

這封公開信究竟說了什麼?

「致命」公開信

22字,言簡意賅:

「降低AI帶來滅絕的風險,應該被提到全球級別的優先程度。就像我們應對傳染病、核戰這種社會危機一樣。」

而簽署這封公開信的AI界人士,一眼根本望不到盡頭。

赫然映入眼簾的就是Geoffrey Hinton、Yoshua Bengio、Google DeepMind的CEO Demis Hassabi、OpenAI的CEO Sam Altman、Anthropic的CEO Dario Amodei。

這的名單裡,Hinton的含金量不用多說,他是前Google副總裁、深度學習泰斗、神經網路之父,以及圖靈獎獲得者。

Yoshua Bengio同樣也是圖靈獎獲得者,和Hinton、LeCun被合稱為圖靈獎3巨頭。

除了在科技巨頭公司任職的大老,還不乏知名AI學者,像是加利福尼亞大學的Dawn Song、北京清華大學的張亞勤。

而在這些耳熟能詳的名字下面,就是數不勝數的AI界人士了。甚至,每個人都可以參與簽署這封公開信。只要填寫姓名、信箱、職位等資訊,就可以參與簽署。

不過,可以選擇的身份只有AI科學家和著名人士2個。

反對:滅絕人類純扯淡

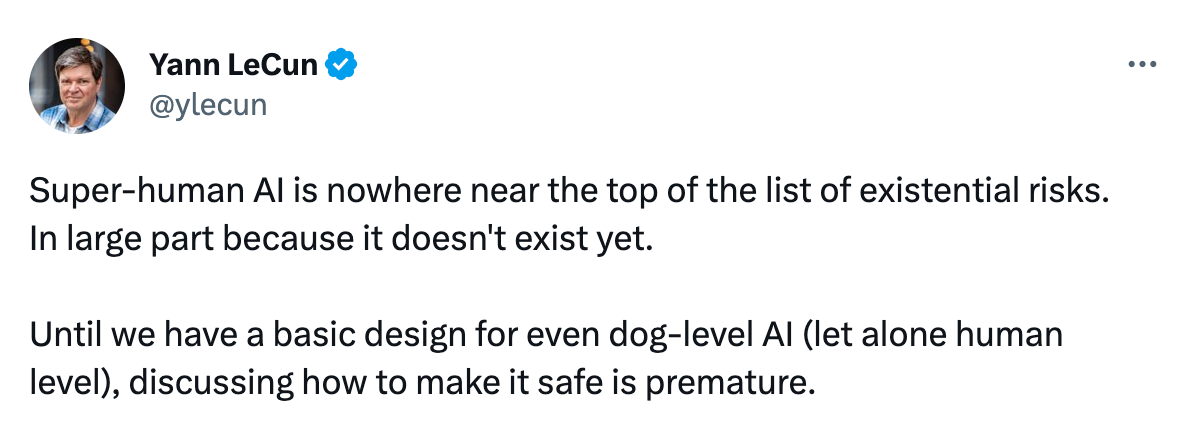

Meta AI首席科學家LeCun還是一如既往的「唱反調」。他一向的觀點都是:現在的AI發展剛到哪啊,就天天把威脅和安全掛在嘴邊。

他表示,列出的威脅,根本不是現在AI發展程度能達到的,因為壓根不存在。在我們設計出狗等級的人工智慧之前(更不用說人類級別),討論如何使其安全還為時過早。

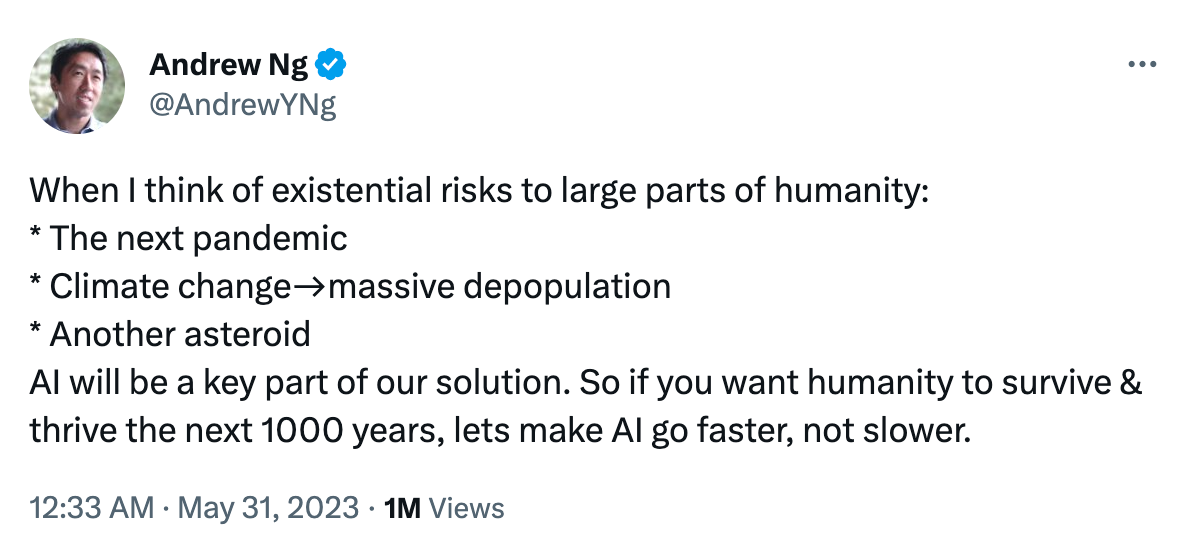

史丹佛大學客座教授、DeepLearning.AI創辦人吳恩達的立場和LeCun相同,但理由卻有點不同。

他認為,不是AI會導致各種問題,而是我們將會遇到的各種問題,只能靠AI來解決。例如:下一次傳染病爆發、氣候變遷導致的人口減少、小行星撞地球等。他表示,人類想繼續生存、繁榮下去,得加速AI的發展,而不是減速。

AI風險面面觀

那麼,這些AI重要人士們宣稱的,AI足以滅絕人類的風險包括什麼呢?他們總結了以下8個面向。

1.武器化

部分人可能會將AI用在具有破壞性的地方,會導致人類的生存風險,並加劇政治動蕩。

例如,現在深度強化學習(Deep Reinforcement Learning)的技術已經可以應用於空戰,機器學習(Machine Learning)能用於製造化學武器(已有論文表明,GPT-4可以在實驗室中自主進行實驗、合成化學品)。

此外,近年來研究人員一直在開發用於自動進行網路攻擊的AI系統,還有軍方領導人想要讓AI控制核彈發射井。

因此,未來AI強國會具有戰略優勢,各國之間的軍備競賽會轉向AI領域。就算大部分國家都確保各自構建的系統是安全的,且不會威脅他國安全,仍然可能有國家蓄意用AI做壞事,造成傷害。

這給人的感覺就像核武,有一個國家不聽話、不老實,把嚴重的事情都當兒戲。

2.資訊誤傳

資訊誤傳這件事情大家早就時有所聞。前一陣子美國律師用ChatGPT打官司,結果舉的案例有6個都是杜撰的例子。

而有影響力的集體,像是國家、政黨、組織抖,都會有能力用AI來影響(通常是潛移默化的)、改變普通人的政治信仰及意識形態等。

同時,AI本身也有能力生成具煽動性或有說服力的觀點,激起用戶強烈的情緒。而這些可能的後果,完全不可預料,不得不防。

3.代理人的「把戲」

AI系統根據具體的目標進行訓練,而這些目標,只是間接代理了人類重視的東西。就好像AI經過訓練,就可以推送用戶他們愛看的影片或文章一樣。但並不代表,這種方式就是好的,人類反而可能會被AI利用。推薦系統可能會導致人們的想法越來越極端,也更容易預測每個用戶的偏好。

而隨著未來AI的性能越來越強、影響越來越大,我們拿來訓練AI系統的目標,也必須更加仔細的確認。

4.人類「退化」

如果看過「機器人總動員」這部電影,我們就能想像在未來時代,機器越來越強,人類會是這副什麼樣子:大腹便便、身體素質低下、毛病一堆。

就是因為,什麼都交給AI了,人類自然就要「退化」了。尤其是在大量崗位被AI的自動化取代的未來光景下,這種場面更成為可能中的可能。

不過,按LeCun的觀點,大概又得駁斥一番。說我們離「機器人總動員」想像的場景還很遠。

5.技術壟斷

與技術本身無關,這一點強調的,是可能會出現的「技術壟斷」。也許有一天,最強大的AI由越來越少的利益相關者掌控,使用權也被他們牢牢的捏在手心。

而真到那一步的話,剩下的普通人,就只能處在一個任人擺布的狀態,因為根本反抗不了,想想劉慈欣的科幻小說「贍養人類」吧。一個終產者靠著AI統治著全球的所有人,多可怕。

6.不可控的發展

這點主要想說明,AI系統發展到某一步,可能結果會超出設計者的想像,且無法再進行控制。實際上這也是主流擔心AI進程最糾結的地方。

總會有人擔心,AI發展到最後,會像魔鬼終結者裡的「天網」一樣,或者鋼鐵人裡的「奧創」,不受掌控,試圖毀滅人類。

或者換句話說,有些風險只有在發展的進程中才能發現,而真到發現時,就已經晚了。甚至還可能會出現新的目標。

7.欺騙

這點有一些抽象,簡單來說,就是AI系統可能會「欺騙」人類。這種「欺騙」並不是故意的,只是因為AI為了實現代理人目標的手段而已。

透過「欺騙」獲得人類的認可,比透過正常管道獲得人類的認可更快速,而效率才是AI首要考慮的要素。

8.追求權力的行為

這點和技術壟斷之間有相關性。正因為會出現技術壟斷的情況,各國就會追求壟斷技術的權力。而這種「追求」,很可能會帶來難以預料的後果。

*本文轉載自公眾號「新智元」(ID:AI_era),原文:Sam Altman預警:AI滅絕人類!375+大佬簽署22字聯名信,LeCun唱反調

責任編輯:倪旻勤

核稿編輯:陳瑋鴻

【更多精彩內容】

AI物種大爆發,焦慮爆棚?AI實戰36技,幫你職場戰力增10倍

AI越快,心要越定》AI革命像轉位轉型!該做深這件事,別被工具迷花眼

AI入門10技》沒空想旅行計畫?心裡有苦想傾訴?從Line就能輕鬆上手

AI職場16技》秒回郵件、摘要會議紀錄、模擬面試⋯它當萬能助手,生產力加倍!

AI斜槓10技》寫文案、做SEO優化、開發遊戲,新工具一次學,助你跨出界限

「IT部門一定要衝第一線」台灣大拚AI,如何用30人帶動全公司?

不惜裁員解散法務、SEO寫手,這家線上家教為何要這樣推AI?

少走AI冤枉路!機器人行員、智能客服踩坑,台新金學會善用「翻譯官」

AI風潮來了,下一步?

每個工作者都要會用AI

ChatGPT狂潮下的美中新大戰!

它讓記者自問「以後會消失嗎?」看6個AI潛入職場、校園的改變現場

「會用AI的人,將取代不會的人」

這是一個開放給所有商周讀者發聲的管道,如果你有意見想法不吐不快,歡迎大聲說出來!(來稿請寄至red_chen@bwnet.com.tw)